सन्दर्भ:

कृत्रिम बुद्धिमत्ता (Artificial Intelligence) आज केवल एक तकनीकी उपकरण नहीं, बल्कि एक ऐसी परिवर्तनकारी शक्ति बन चुकी है जो समाज, अर्थव्यवस्था और शासन की मूल संरचना को बदल रही है। रोगों का शीघ्र निदान, फसल विफलता की भविष्यवाणी, शिक्षा की पहुँच में सुधार और प्रशासनिक प्रक्रियाओं को गति देना, ये सभी उदाहरण दिखाते हैं कि कृत्रिम बुद्धिमत्ता मानव जीवन को कितनी व्यापक दिशा में प्रभावित कर सकती है।

-

- किन्तु इसके साथ कई गंभीर जोखिम भी जुड़े हैं। भ्रामक जानकारी का तीव्र प्रसार, व्यक्तिगत डेटा के दुरुपयोग की संभावना, गहन कृत्रिम वीडियो (डीपफेक) द्वारा फर्जी पहचान निर्माण तथा राष्ट्रीय सुरक्षा पर उभरते खतरे, ये सभी चुनौतियाँ नीति-निर्माण के लिए अत्यंत महत्वपूर्ण हैं।

- इन्हीं अवसरों और जोखिमों के बीच संतुलन स्थापित करने के उद्देश्य से इलेक्ट्रॉनिक्स और सूचना प्रौद्योगिकी मंत्रालय ने हाल ही में कृत्रिम बुद्धिमत्ता शासन-निर्देशिका (Artificial Intelligence Governance Guidelines) जारी की है। यह एक व्यापक ढांचा है जिसका उद्देश्य नवाचार को प्रोत्साहित करते हुए यह सुनिश्चित करना है कि कृत्रिम बुद्धिमत्ता का विकास सुरक्षित, नैतिक और जवाबदेह बना रहे। यह ढांचा “सबके लिए एआई” की राष्ट्रीय दृष्टि पर आधारित है, जो वर्ष 2047 तक विकसित भारत बनाने के लक्ष्य से जुड़ता है।

दृष्टिकोण और आधारभूत सिद्धांत

भारत का कृत्रिम बुद्धिमत्ता दृष्टिकोण “किसी को नुकसान न पहुँचाने” के सिद्धांत पर आधारित है। इसका अर्थ यह है कि तकनीकी प्रगति समाज के हितों के साथ सामंजस्यपूर्ण हो तथा किसी भी प्रकार का दुष्परिणाम उत्पन्न न करे।

दिशानिर्देश तीन प्रमुख सिद्धांतों पर आधारित हैं:

· मानव-केंद्रित दृष्टिकोण: कृत्रिम बुद्धिमत्ता मनुष्य का विकल्प नहीं, बल्कि उसका सहायक बने।

· समावेशन और समानता: समाज के हर वर्ग को कृत्रिम बुद्धिमत्ता के लाभ समान रूप से प्राप्त हों।

· सुरक्षा और जवाबदेही: तकनीक विकसित करने वाली संस्थाएँ, उनका उपयोग करने वाली इकाइयाँ तथा सरकार—तीनों की साझा जिम्मेदारी हो।

कृत्रिम बुद्धिमत्ता शासन-ढांचे के प्रमुख आधारस्तंभ

यह शासन-ढांचा छह प्रमुख स्तंभों पर आधारित है, जो मिलकर एक व्यापक और सुनियोजित व्यवस्था निर्मित करते हैं।

1. तकनीकी आधार-संरचना का विकास:

कृत्रिम बुद्धिमत्ता के लिए विशाल मात्रा में डेटा और उच्च-गति कंप्यूटिंग क्षमता की आवश्यकता होती है। दिशानिर्देश इस दिशा में निम्नलिखित प्रावधान सुझाते हैं:

· भारत-केंद्रित उच्च गुणवत्ता वाले डेटा भंडार उपलब्ध कराना।

· स्टार्टअप और अनुसंधान संस्थानों के लिए किफायती कंप्यूटिंग संसाधन (जैसे उच्च प्रदर्शन प्रसंस्करण इकाइयाँ) उपलब्ध कराना।

· आधार, एकीकृत भुगतान इंटरफेस और डिजिलॉकर जैसे विभिन्न डिजिटल सार्वजनिक ढाँचों के साथ कृत्रिम बुद्धिमत्ता समाधान जोड़कर सेवा-प्रदान को अधिक सक्षम बनाना।

· सूक्ष्म, लघु और मध्यम उद्यमों को कर राहत तथा एआई-आधारित ऋण सुविधा प्रदान करना।

ये उपाय कृत्रिम बुद्धिमत्ता को अधिक सुलभ, वहनीय और व्यापक बनाने की दिशा में निर्णायक कदम हैं।

2. विनियमन और नीति का हल्का लेकिन लचीला ढांचा:

भारत ने तत्काल किसी कठोर और स्वतंत्र कृत्रिम बुद्धिमत्ता कानून को लागू करने के स्थान पर एक “हल्के लेकिन लचीले” विनियामक मॉडल को चुना है।

इसके अंतर्गत:

· सूचना प्रौद्योगिकी अधिनियम तथा डिजिटल व्यक्तिगत डेटा संरक्षण अधिनियम मौजूदा कानूनी आधार प्रदान करेंगे।

· कृत्रिम सामग्री की सत्यता, दायित्व निर्धारण और कॉपीराइट से जुड़े मुद्दों पर लक्षित संशोधन किए जाएँगे।

· कृत्रिम वीडियो (डीपफेक) और दुष्प्रचार रोकने के लिए एआई-निर्मित सामग्री की स्पष्ट पहचान अनिवार्य की जाएगी।

· भारत अंतरराष्ट्रीय मानकों और नैतिक ढाँचों के निर्माण में सहयोग करेगा।

यह मॉडल नवाचार को बाधित किए बिना जवाबदेही और सुरक्षा सुनिश्चित करता है।

3. जोखिम की पहचान और रोकथाम:

कृत्रिम बुद्धिमत्ता प्रणालियाँ यदि गलत दिशा में जाएँ तो गंभीर हानि पहुँचा सकती हैं। इन्हें रोकने के लिए सरकार ने:

· भारत की विशिष्ट परिस्थितियों को ध्यान में रखते हुए जोखिम मूल्यांकन ढांचा विकसित करने,

· उद्योगों से स्वैच्छिक आचार-संहिता अपनाने, तथा

· गोपनीयता, निष्पक्षता और पारदर्शिता को प्रणाली के भीतर ही स्थापित करने जैसे उपाय सुझाए हैं।

इससे तकनीकी और कानूनी सुरक्षा दोनों सुनिश्चित होंगी।

4. जवाबदेही सुनिश्चित करने की व्यवस्था:

एआई पारिस्थितिकी तंत्र में जिम्मेदारी निर्धारण एक महत्वपूर्ण पहलू है। इसलिए दिशानिर्देश स्तरित दायित्व प्रणाली प्रस्तुत करते हैं, जहाँ जोखिम जितना अधिक, जिम्मेदारी उतनी अधिक।

इसके अंतर्गत:

· उपयोगकर्ताओं के हितों की रक्षा हेतु शिकायत निवारण तंत्र स्थापित किए जाएँगे।

· कंपनियों को यह सार्वजनिक रूप से बताना होगा कि उनकी एआई प्रणालियों को कैसे प्रशिक्षित, परीक्षण और निगरानी किया गया।

· संस्थाओं को नैतिक और तकनीकी मानकों के अनुपालन का स्व-प्रमाणन करना होगा।

5. जन-शिक्षा एवं कौशल-विकास:

कृत्रिम बुद्धिमत्ता का वास्तविक प्रभाव तभी संभव है जब नागरिक, अधिकारी और संस्थान इसे समझें।

दिशानिर्देशों में:

· नागरिकों के लिए जागरूकता अभियान,

· प्रशासनिक और सुरक्षा बलों के लिए विशेष प्रशिक्षण, और

· छोटे शहरों तथा शैक्षणिक संस्थानों में कौशल-विकास कार्यक्रमों का विस्तार शामिल है।

इससे तकनीक का लोकतांत्रिक और जिम्मेदार उपयोग सुनिश्चित होगा।

6. संस्थागत ढांचे का निर्माण:

सरकार ने कृत्रिम बुद्धिमत्ता शासन को सुचारु बनाने के लिए तीन प्रमुख संस्थाएँ प्रस्तावित की हैं:

1. कृत्रिम बुद्धिमत्ता शासन समूह — नीति-निर्माण और समन्वय हेतु।

2. प्रौद्योगिकी एवं नीति विशेषज्ञ समिति — तकनीकी और नैतिक परामर्श हेतु।

3. कृत्रिम बुद्धिमत्ता सुरक्षा संस्थान — जोखिम मूल्यांकन एवं सुरक्षा अनुसंधान हेतु।

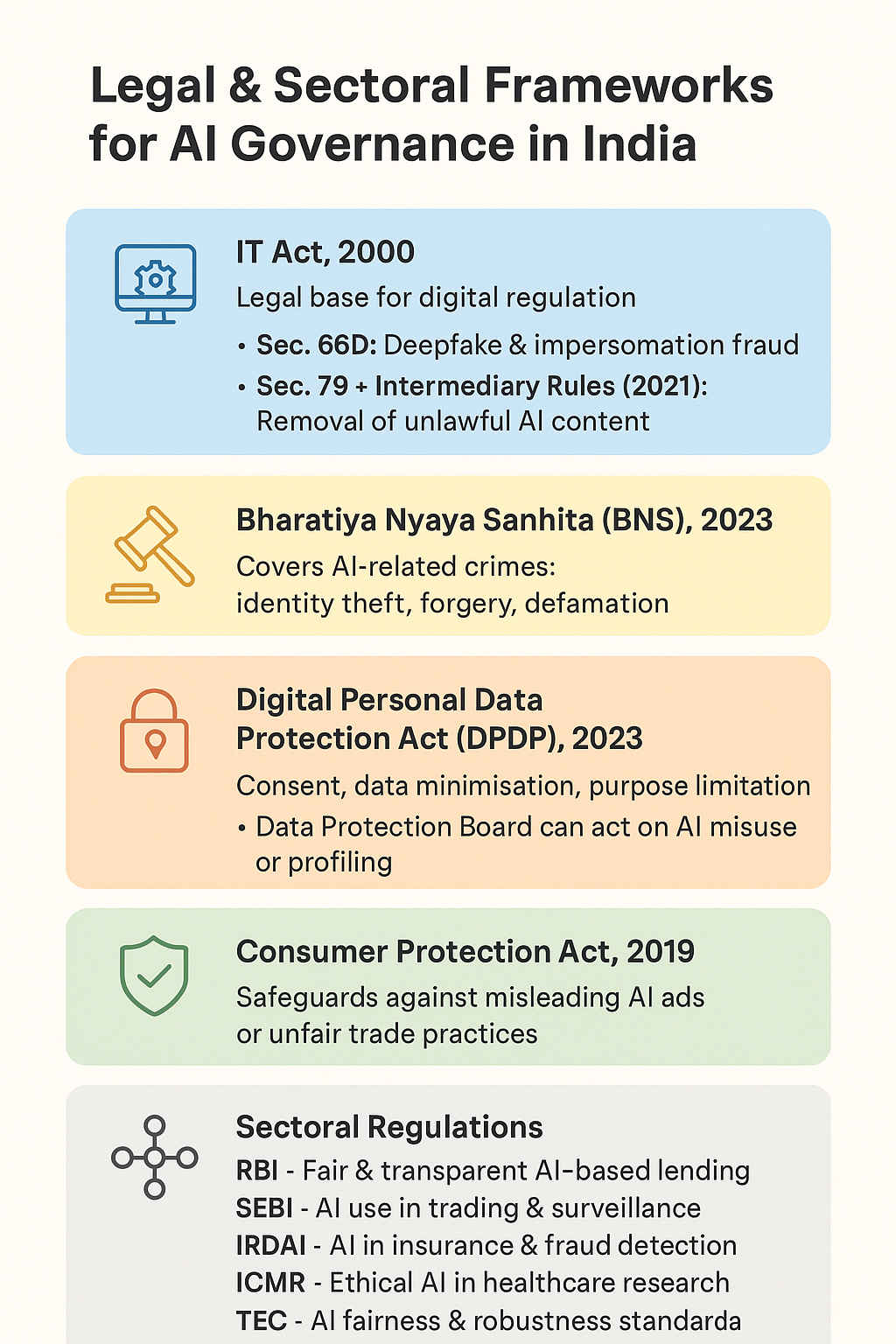

कानूनी और क्षेत्रीय समर्थन-ढाँचा:

सूचना प्रौद्योगिकी अधिनियम, 2000

· प्रतिरूपण आधारित धोखाधड़ी (जैसे डीपफेक) को अपराध घोषित करता है।

· मध्यस्थ संस्थाओं को हानिकारक सामग्री हटाने के लिए बाध्य करता है।

भारतीय न्याय संहिता, 2023

-

-

- पहचान चोरी, जालसाजी और एआई-संचालित धोखाधड़ी शामिल।

- पहचान चोरी, जालसाजी और एआई-संचालित धोखाधड़ी शामिल।

-

डिजिटल व्यक्तिगत डेटा संरक्षण अधिनियम, 2023

-

-

- डेटा न्यूनतमकरण, सहमति और उद्देश्य-सीमित उपयोग को कानूनी स्वरूप देता है।

- डेटा न्यूनतमकरण, सहमति और उद्देश्य-सीमित उपयोग को कानूनी स्वरूप देता है।

-

उपभोक्ता संरक्षण अधिनियम, 2019

-

-

- भ्रामक एआई विज्ञापनों और अनुचित व्यापार आचरण से सुरक्षा प्रदान करता है।

- भ्रामक एआई विज्ञापनों और अनुचित व्यापार आचरण से सुरक्षा प्रदान करता है।

-

क्षेत्र-विशिष्ट विनियम

· आरबीआई—डिजिटल ऋण और क्रेडिट मूल्यांकन में निष्पक्षता।

· सेबी—बाज़ार निगरानी में एआई उपयोग।

· आईआरडीएआई—बीमा अंडरराइटिंग में एआई जोखिम प्रबंधन।

· आईसीएमआर—चिकित्सा अनुसंधान में नैतिक एआई।

· मानक निर्धारण संस्थाएँ—विश्वसनीय एआई के भारतीय मानक विकसित करना।

· साइबर सुरक्षा संस्थाएँ—एआई से संबंधित घटनाओं की रिपोर्टिंग सुनिश्चित करना।

उभरती चिंताएँ: सरकारी संवेदनशीलता और विदेशी मंचों का उपयोग:

हाल के समय में यह चिंता व्यक्त की गई है कि यदि कोई अधिकारी गोपनीय दस्तावेज़ों को कृत्रिम बुद्धिमत्ता चैटबॉट पर अपलोड करता है, तो डेटा विदेशी सर्वरों पर संग्रहीत होकर दुरुपयोग हो सकता है। इससे सरकारी नीतियों और रणनीतिक जानकारी के अनचाहे खुलासे की आशंका भी बढ़ जाती है।

इसीलिए सुरक्षित, स्वदेशी कृत्रिम बुद्धिमत्ता प्रणालियाँ विकसित करने की आवश्यकता पर बल दिया जा रहा है।

डीपफेक और गलत सूचना का नियंत्रण:

सरकार सूचना प्रौद्योगिकी नियमों में संशोधन करने जा रही है, जिसके अंतर्गत:

· यह अनिवार्य होगा कि उपयोगकर्ता अपनी सामग्री के कृत्रिम रूप से निर्मित होने की जानकारी दें।

· मंचों को इसे सत्यापित कर दृश्यमान पहचान, अर्थात स्पष्ट चेतावनी लगानी होगी।

· ऐसा न करने पर मंचों को सूचना प्रौद्योगिकी अधिनियम की वह कानूनी सुरक्षा नहीं मिलेगी जिसका वे अभी लाभ उठा रहे हैं।

निष्कर्ष:

भारत की कृत्रिम बुद्धिमत्ता शासन-निर्देशिका एक महत्वपूर्ण कदम है, जो न केवल तकनीकी प्रगति को दिशा देती है, बल्कि सुरक्षा, गोपनीयता, नैतिकता और जवाबदेही के बीच संतुलन भी स्थापित करती है। यह मॉडल विकासशील देशों के लिए एक मार्गदर्शक ढांचा बन सकता है।

| UPSC/PSC Main Question: |